4 月 30 日消息,螞蟻集團旗下的百靈大模型今日宣佈,今天將 Ling-2.6-1T 正式開源。

官方表示,Ling-2.6-1T 並不是為了單純追求更長的思考鏈,或製造更強的“參數規模體感”,而是面向真實複雜任務,系統性優化模型的智效比、指令執行、工具適配、長上下文承接和工程任務處理能力。該模型重點解決三個問題:

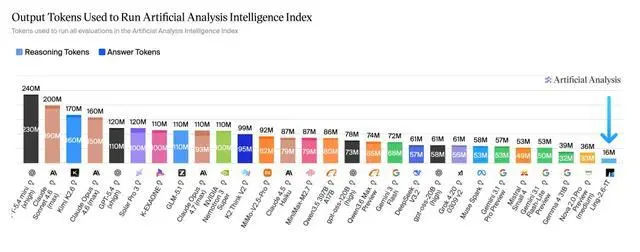

在更低 Token 開銷下保持強綜合智能:依託 MLA 與 Linear Attention 的 Hybrid 架構創新,結合抑制“過程冗餘”的強化獎勵策略,Ling-2.6-1T 在保持 1T 參數能力上限的同時,減少對冗長思考鏈的依賴,以更高效的“快思考”機制直達結果,從而壓縮同等智能水準下的輸出成本。

在複雜任務中實現更可靠的多步執行:在 Agent、Coding 和工作流場景中,模型需要的不只是單點回答能力,而是對指令、工具、上下文和中間狀態的持續把控,在雜訊環境下的推理與精准作答。Ling-2.6-1T 加強對複合型任務的學習,在 AIME26、SWE-bench Verified、BFCL-V4 、TAU2-Bench、IFBench 等執行類基準上達到開源 SOTA 水準,展現出面向複雜任務的綜合執行能力。

讓萬億級模型真正進入開發者和企業的生產工作流:Ling-2.6-1T 具備從代碼生成到缺陷修復的完整工程落地能力,並與主流 Agent 框架高度相容,適用於多工具、多步驟、多約束的複雜場景。它的目標不是停留在單次演示,而是成為真實業務系統中可部署、可協同、可持續運行的模型能力底座。

Ling-2.6-1T 以 16M tokens 完成 Artificial Analysis 完整評測

官方還表示,為支持更多開發者體驗與評測 Ling-2.6-1T,將 OpenRouter 平臺的免費 API 調用服務延期一周。

來源:中國IT之家

- 相關推荐

-

-

臺積電更新SoIC 3D晶片封裝堆疊技術路線圖:2029年互連間距縮至4.5μm链接阅读

臺積電更新SoIC 3D晶片封裝堆疊技術路線圖:2029年互連間距縮至4.5μm链接阅读 -

AI編程熱潮推動GitHub爆發增長,平臺頻發故障後啟動底層基礎設施重構链接阅读

AI編程熱潮推動GitHub爆發增長,平臺頻發故障後啟動底層基礎設施重構链接阅读 -

蘋果擬深化iPhone人工智慧體驗 iOS 27推出“Siri相機模式”並升級視覺智能功能链接阅读

蘋果擬深化iPhone人工智慧體驗 iOS 27推出“Siri相機模式”並升級視覺智能功能链接阅读 -

“磐石100”模型體系發佈,為科學研究提供智能支撐链接阅读

“磐石100”模型體系發佈,為科學研究提供智能支撐链接阅读 -

腦機介面風頭正勁,但別忽視“輔助”二字链接阅读

腦機介面風頭正勁,但別忽視“輔助”二字链接阅读 -

Xiaomi-Robotics-0訓練全流程!機器人操作:收納耳機链接阅读

Xiaomi-Robotics-0訓練全流程!機器人操作:收納耳機链接阅读 -

顏寧團隊、薛其坤-陳卓昱團隊分別發佈重大科研成果链接阅读

顏寧團隊、薛其坤-陳卓昱團隊分別發佈重大科研成果链接阅读 -

AI+共用自動化實驗室:蛋白質研發從“大平臺驅動”走向“個人開發”链接阅读

AI+共用自動化實驗室:蛋白質研發從“大平臺驅動”走向“個人開發”链接阅读

-

您當前的位置 :

您當前的位置 :