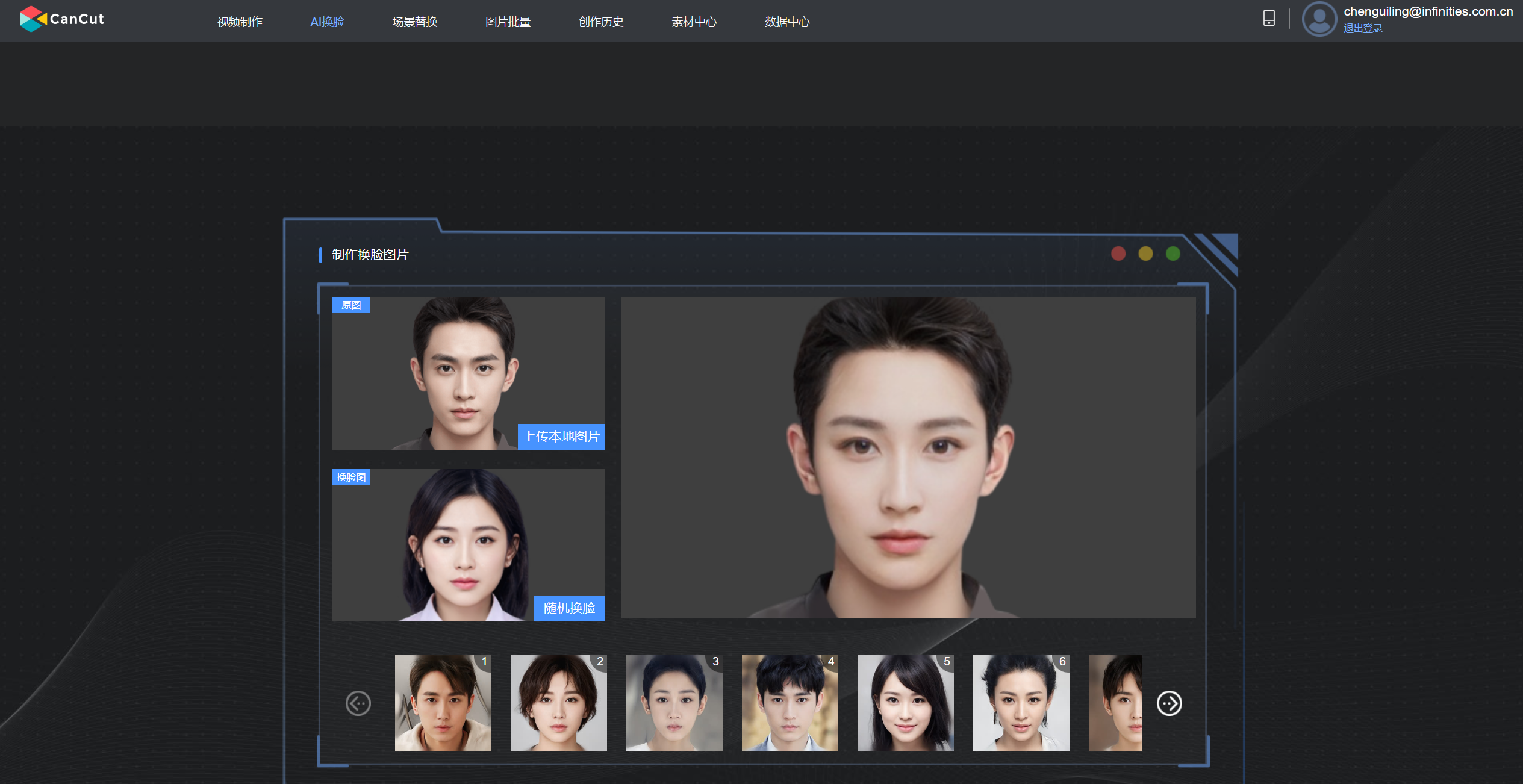

我們常說“眼見為實”,但在AI時代,肉眼所看見的也不一定是真相。一些不法分子利用“AI換臉”技術實施詐騙,已成為一種新型騙局。一張“肖像照片”、一段“貌似熟人的視頻”,都可能被不法分子利用作為詐騙的手段和工具。

電信網絡詐騙本就變幻莫測,讓人防不勝防,如今有了AI換臉技術的“加持”,更加大了防騙反詐的難度。對此,民眾不僅要進一步擦亮眼睛、提高警惕,還需要技術力量有更大的作為,在技防層面實現“降維打擊”。

雖然AI換臉幾乎可以一鍵完成,但其依託的深度合成技術還是存在很高技術門檻與壁壘的。被不法分子利用來進行詐騙的AI換臉軟件,大概率也是依託於各大科技公司或單位開發的相關產品,因而要在源頭上阻止AI換臉技術被濫用,理論上不存在太大困難,畢竟絕大多數詐騙分子或團夥還沒強大到能自主研發一套AI換臉系統。

動用技術力量打擊AI換臉詐騙,一方面要從源頭上防止技術被濫用。對於一些開放性的技術或AI模型,平臺當然沒有辦法阻止詐騙分子使用,可對於此類幾乎能以假亂真的深度合成技術內容,顯然要有必要的提醒,明確告知受眾其為AI技術生成的產品。

另一方面,要加大對AI換臉詐騙行為的識別力度。不法分子利用AI生成的圖片、視頻實施詐騙,完成換臉只是第一步,接下來還需要通過各種社交媒體平臺向潛在目標傳輸虛假照片或視頻,以達到迷惑對方實施詐騙的目的。在這種情況下,各大平臺如果能研發並及時推出AI換臉詐騙檢測與預警機制,那無形中又給用戶的安全加了把鎖。

除了技防層面的不斷強化之外,反電詐宣傳也要與時俱進,將AI換臉類詐騙的識別、防範及時納入宣傳範疇,讓大家知曉在AI生成技術面前,有圖不一定有真相,即便是視頻也可以被偽造,讓大家在網路生活中務必多留個心眼。

面對層出不窮的新型騙局套路和花樣,作為自身安全第一責任人的廣大民眾,做好“提高警惕心莫貪”“陌生鏈接不點擊”等常規防騙措施外,更要有針對性地防範AI換臉詐騙。AI換臉得以進行的前提是掌握了目標對象的面部資訊與動作,讓AI技術有訓練與學習的數據素材。因而,大家在網路生活交往中,要進一步保護好自己的人臉等生物資訊,不過度公開或分享動圖、視頻,不法分子無法輕易獲取行騙對象的面部資訊,自然也就無法通過AI換臉來實施詐騙行為了。可見,隨著詐騙技術的水漲船高,民眾的安全意識與防騙技能也要相應加以提升。

來源:中國青年報

您當前的位置 :

您當前的位置 :